RealBuddy: Wir haben einen KI-Kumpel gebaut, der bei Gesprächen mithört und sich einschaltet

Meine Kollegen und ich führen regelmässig Diskussionen über KI — meistens emotional, oft mit Halbwissen, und genau das macht sie gut. Aber irgendwann kam die Frage auf: Was wäre, wenn jemand mit am Tisch sitzen würde, der zumindest theoretisch alle Fakten überprüfen könnte?

Dazu kam ein zweiter Gedanke, der mich schon länger beschäftigt: Warum nutzen wir KI eigentlich immer nur passiv? Wir triggern, die KI antwortet. Frage-Antwort, Frage-Antwort. Autonome KI — also eine, die selbst entscheidet, wann sie sich einschaltet — fand ich schon immer spannender. Also haben wir RealBuddy gebaut.

Was RealBuddy ist

RealBuddy ist kein Sprachassistent. Kein "Hey Siri", kein Kommando, keine Frage-Antwort-Mechanik. Er ist ein passiver Zuhörer — ein KI-Kumpel, der bei Gesprächen im Raum mithört und sich von selbst einschaltet, wenn er etwas Sinnvolles beitragen kann. Wie ein Freund, der mit am Tisch sitzt und ab und zu was einwirft.

Der Unterschied zu klassischen Assistenten: Alexa oder Siri reagieren auf Kommandos und liefern eine Antwort auf eine Frage. RealBuddy verfolgt das ganze Gespräch, erkennt Kontext, Themen und Stimmung — und entscheidet selbst, ob und wann er etwas sagt.

Das Entscheidungssystem: Wann darf er sprechen?

Der interessanteste Teil von RealBuddy ist nicht die Spracherkennung oder die Antwortgenerierung — sondern die Entscheidung, ob er überhaupt den Mund aufmacht. Dafür haben wir ein mehrstufiges Gate-System gebaut:

Zürst prüft er die Relevanz: Ist das Thema etwas, wozu er Mehrwert liefern kann? Dann die Priorität: Falsche Fakten im Gespräch haben hohe Dringlichkeit, Smalltalk eher nicht. Danach das Timing: Gibt es gerade eine natürliche Pause? Redet jemand? Und schliesslich die Confidence: Sind alle Faktoren zusammen hoch genug, um sich einzuschalten?

Dazu kommt ein KPI-Tracker pro Thema mit EMA-Smoothing, damit nichts sprunghaft reagiert. Ein organisches Warmup nach dem Sprechen, Staleness-Decay für alte Themen und eine Repetition-Penalty, damit er sich nicht wiederholt. Plus ein harter Cooldown von 60 Sekunden zwischen Einschaltungen.

Das Ziel war: Er soll sich anfühlen wie ein aufmerksamer Zuhörer, nicht wie ein übereifriger Besserwisser.

Der technische Stack

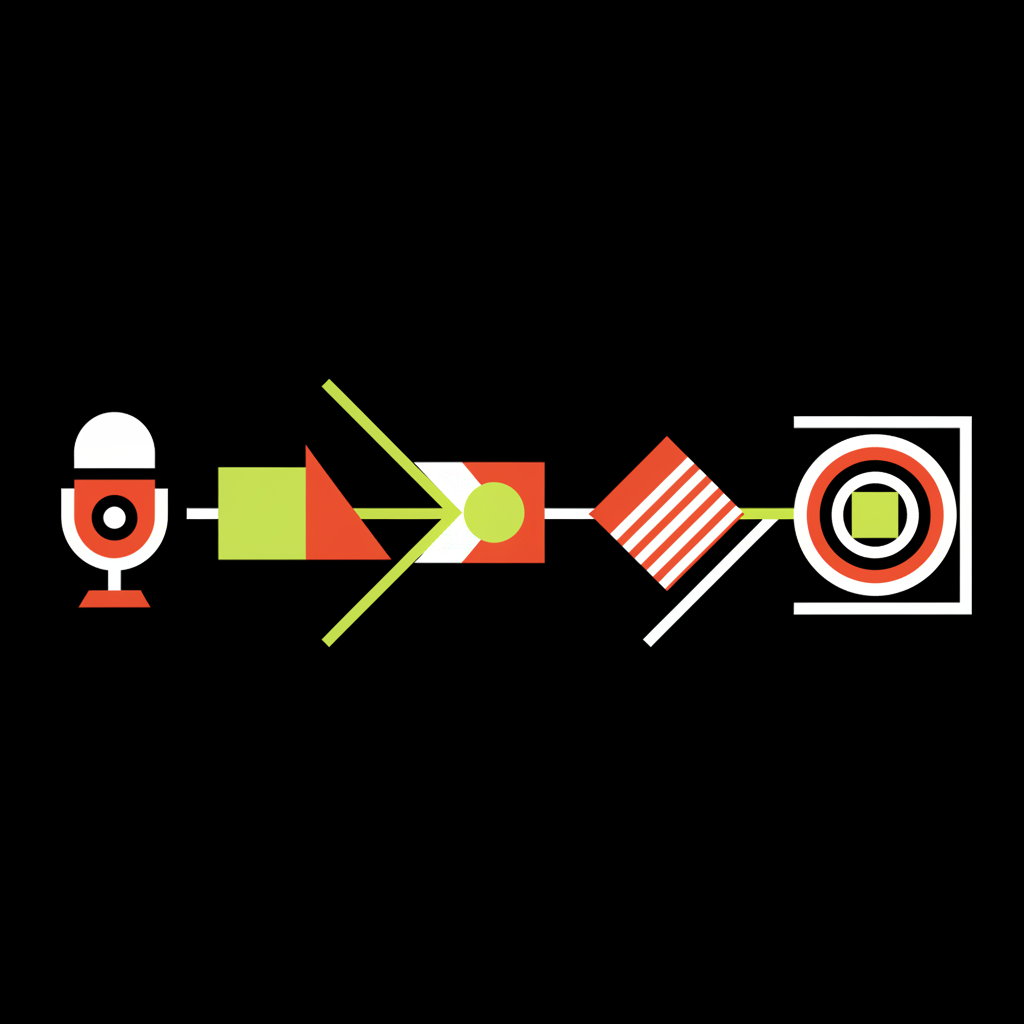

Die Audio-Pipeline: Silero VAD erkennt Sprache im Audiostrom, Groq Whisper transkribiert in 10-Sekunden-Chunks — nicht ganz Echtzeit, aber extrem schnell, das LLM analysiert den Kontext und formuliert Antworten, ElevenLabs macht Sprache daraus.

Als LLM nutzen wir Groq — ein grösseres Modell für die Antworten, ein kleineres für die schnelle Analyse, ob überhaupt reagiert werden soll. Dazu ein Dual-RAG-System mit ChromaDB: eine Collection für Gespräche (was wurde gesagt), eine für Hintergrund-Recherche (Fakten, die ein Background-Researcher automatisch im Web nachschlägt, während wir reden).

Das Audio kommt über den Browser — AudioWorklet API streamt 16kHz PCM via WebSocket zum Server, TTS-Audio kommt als Binary WebSocket zurück. Das Ganze läuft in einem Docker Container mit Dashboard im Browser, auch vom Handy nutzbar.

Von der Tray-App zum konfigurierbaren Kumpel

RealBuddy hat mehrere Iterationen durchlaufen. Angefangen als lokale macOS Tray-App mit einem einzelnen Buddy und festem Charakter. Dann eine Phase mit vier gleichzeitig aktiven Persönlichkeiten — ein 80er-Kumpel, ein trockener Sarkast, ein herzlicher Typ und ein DDR-Politiker. Jeder mit eigener Stimme, eigenem Trigger-Verhalten, eigenen Themen-Affinitäten. Ein Arbitration-System entschied, wer sprechen darf.

Am Ende haben wir vereinfacht: eine konfigurierbare Default-Persona statt vier fester. Im Dashboard kann man den Charakter-Prompt anpassen, die Stimme aus allen ElevenLabs-Voices wählen und per Slider einstellen, wie redselig er sein soll. Die Antworten sind bewusst kurz gehalten — 1-2 Sätze, maximal 80 Token.

Was dabei rauskam

Die Entwicklung war iterativ und gesprächsgetrieben. Wir haben getestet, Feedback gegeben, sofort angepasst. "Antwortet zu schnell" — Cooldown hoch. "Zu lang" — Token-Limit runter. "Kein Empathie" — emotional_need in die LLM-Analyse eingebaut, mit Fast-Track bei Traurigkeit oder Frustration.

Drei Fast-Tracks haben sich als besonders nützlich erwiesen: Faktenkorrektur (wenn jemand nachweislich falsch liegt), Empathie (wenn die Stimmung kippt) und Pending Decisions (wenn eine Frage im Raum steht, die keiner beantwortet).

Die ehrliche Einschätzung: RealBuddy ist ein Experiment, kein fertiges Produkt. Manchmal trifft er den perfekten Moment und wirft genau den richtigen Fakt ein. Manchmal ist sein Timing daneben oder er kommentiert etwas, das längst vom Tisch ist. Aber als Prototyp zeigt er, dass autonome KI-Interaktion möglich ist — und sich grundlegend anders anfühlt als Frage-Antwort.

Fazit

Die Frage, die uns zu RealBuddy geführt hat, war eigentlich simpel: Was passiert, wenn KI nicht wartet, bis man sie fragt? Das Ergebnis ist ein System aus etwa 15 Python-Modulen, das zuhört, mitdenkt, im Hintergrund recherchiert und sich einschaltet, wenn es glaubt, etwas beitragen zu können.

Ob das die Zukunft von KI-Interaktion ist, weiss ich nicht. Aber es fühlt sich näher an dem an, wie wir mit Menschen interagieren, als alles, was ich bisher mit Sprachassistenten erlebt habe. Und es hat unsere Diskussionen am Tisch definitiv interessanter gemacht — auch wenn RealBuddy manchmal daneben liegt. Aber das tun wir ja auch.